Bayangkan Anda mengunduh riwayat pesan selama lima tahun dengan sahabat-sahabat Anda. Anda memegang file sebesar 15MB yang penuh dengan lelucon internal, perdebatan tengah malam, dan ribuan stempel waktu yang terfragmentasi. Anda mencoba menyalin potongan pertama ke antarmuka chat AI generik, berharap mendapatkan ringkasan yang seru. Namun, sistem justru macet, kehilangan jejak siapa yang berbicara, atau bahkan mengarang percakapan yang tidak pernah terjadi. Saat ini, transisi dari model bahasa generik ke arsitektur pengukuran khusus sedang memecahkan masalah ini. Alih-alih mengandalkan chatbot AI standar, pengguna mulai beralih ke aplikasi rekap khusus yang memproses ekspor teks besar secara aman dan mengekstrak narasi terstruktur tanpa kehilangan konteks.

Pekerjaan harian saya sebagai pengembang backend melibatkan penataan layanan komunikasi berbasis cloud dan integrasi API. Saya terus-menerus berurusan dengan data mentah yang tidak terstruktur. Banyak orang berasumsi bahwa memasukkan log chat mentah ke dalam model bahasa standar adalah tugas yang mudah. Padahal tidak demikian. Riwayat chat bersifat berantakan, non-linear, dan padat. Untuk mendapatkan nilai nyata dari riwayat pesan Anda, Anda memerlukan pendekatan metodis dalam pemrosesan data.

Langkah 1: Mengapa kebiasaan berkirim pesan kita menuntut infrastruktur teknis yang lebih baik?

Sebelum mencoba membedah data Anda sendiri, ada baiknya memahami skala masalahnya. Kita menghasilkan lebih banyak data percakapan daripada sebelumnya. Menurut data industri seluler terbaru, sesi aplikasi global dan pengeluaran konsumen terus mencapai rekor tertinggi, menekankan kedalaman keterlibatan seluler. Seiring dengan semakin dalamnya interaksi digital kita, volume data teks yang tersimpan di perangkat kita pun tumbuh secara eksponensial.

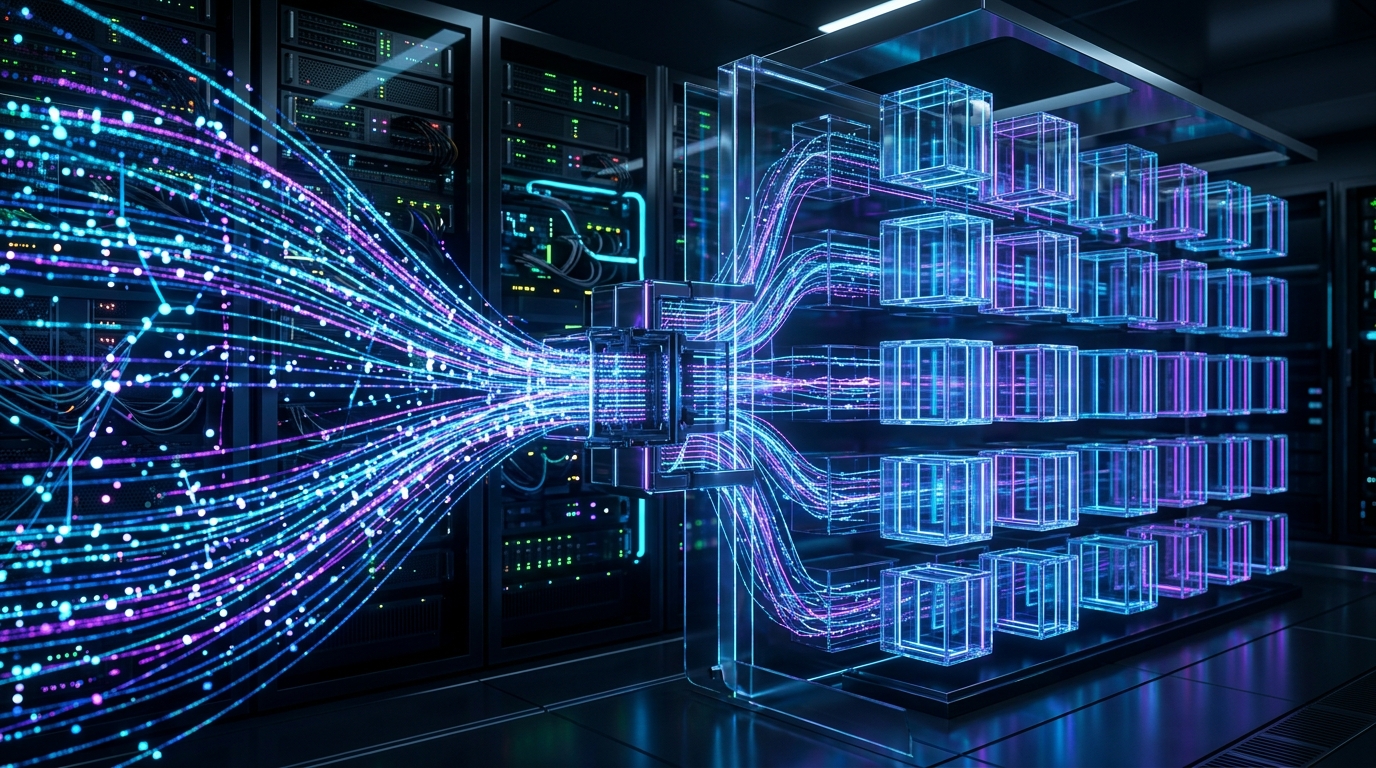

Tren terbaru menyoroti pergeseran krusial menuju "AI + Arsitektur Pengukuran." Ini menunjukkan perubahan mendasar dalam cara kita menangani data. Kecerdasan buatan bukan lagi sekadar alat mandiri untuk mengobrol; AI menjadi infrastruktur fondasi yang digunakan untuk segmentasi data yang kompleks dan pemrosesan ujung-ke-ujung (end-to-end). Jika Anda ingin menganalisis pola komunikasi Anda, Anda memerlukan alat yang dibangun di atas arsitektur khusus semacam ini, bukan sekadar perintah teks kosong.

Tips untuk tahap ini: Tentukan tujuan Anda yang sebenarnya. Pendekatan ini khusus untuk individu, teman, dan tim kecil yang ingin mengubah ekspor chat pribadi mereka menjadi ringkasan yang menghibur dan terstruktur. Ini BUKAN untuk analis data CRM perusahaan yang ingin membangun alur dukungan pelanggan otomatis.

Langkah 2: Mengapa platform umum gagal dalam mempertahankan konteks?

Saya sering meninjau kueri perutean yang masuk ke sistem analisis backend. Orang-orang yang mencari solusi sering mengetik variasi seperti cha t gpt, chat gp t, atau bahkan wchat gpt di toko aplikasi. Baik pengguna mencari chàt gpt, gbt char, atau menguji antarmuka seperti deepseek dan grok ai, masalah dasarnya tetap sama: batasan token.

Setiap sistem chat AI memproses teks dalam satuan "token." Saat Anda menempelkan log WhatsApp messenger yang besar ke dalam chat GPT generik, model tersebut membaca stempel waktu, nama, dan pesan sistem (seperti "Gambar diabaikan") sebagai token. Kapasitas memorinya cepat terpenuhi. Pada saat ia membaca pesan bulan Januari, ia sudah lupa apa yang terjadi di bulan November. Alur narasinya pun hancur.

Selain itu, model tujuan umum dilatih untuk menjawab pertanyaan, bukan bertindak sebagai analis data untuk file JSON atau TXT mentah. Ketika mereka menemukan bahasa gaul atau peralihan konteks yang intens—yang biasa terjadi dalam chat grup—mereka mengalami halusinasi. Infrastruktur khusus diperlukan untuk menyaring gangguan (noise) bahkan sebelum model memulai analisisnya.

Langkah 3: Bagaimana cara mengidentifikasi kerangka kerja privasi dan pemrosesan yang tepat?

Mengekspor data pesan pribadi memerlukan pertimbangan privasi yang ketat. Jika Anda mengunggah interaksi pribadi selama setahun, Anda harus mengevaluasi kebijakan penanganan data alat tersebut.

Saat memilih aplikasi untuk tugas ini, gunakan kriteria berikut:

- Efemeritas Data: Apakah aplikasi menyimpan pesan Anda secara permanen, atau langsung menghapus teks mentah setelah analisis selesai?

- Spesifisitas Platform: Apakah aplikasi dapat membaca format spesifik yang diekspor oleh aplikasi pesan Anda secara asli, mengenali di mana satu pesan berakhir dan balasan dimulai?

- Format Output: Apakah aplikasi memberikan dinding teks yang datar, atau ringkasan yang menarik secara visual (seperti gaya output "Wrapped")?

Alat generik sering kali menggunakan masukan Anda untuk melatih model di masa depan. Alat khusus harus mengisolasi data sesi Anda. Fokus yang meningkat pada persetujuan data sangat jelas di pasar yang lebih luas; laporan tentang App Tracking Transparency (ATT) menunjukkan bahwa pengguna menjadi jauh lebih berhati-hati tentang ke mana data mereka pergi. Pilihan alat analisis Anda harus mencerminkan kewaspadaan tersebut.

Langkah 4: Apa manfaat dari segmentasi konteks mendalam?

Dari sudut pandang teknik, solusi untuk memproses file teks besar adalah segmentasi konteks mendalam. Alih-alih memaksakan seluruh file ke dalam satu perintah (prompt), sistem yang berarsitektur baik memecah dokumen menjadi blok-blok logis berdasarkan jeda waktu atau pergeseran topik.

Sementara ringkasan AI generik sering kali menghilangkan nuansa dari pesan pribadi, algoritma segmentasi memetakan hubungan antar peserta terlebih dahulu. Mereka mengidentifikasi siapa pembicara utama, frasa apa yang paling sering digunakan, dan kapan aktivitas puncak terjadi. Hanya setelah metadata ini terstruktur, sistem meneruskan blok yang terorganisir ke backend chat kecerdasan buatan untuk pembuatan narasi.

Inilah sebabnya mengapa mencari chats gpt atau chatgtp biasanya berujung pada kekecewaan. Antarmuka web standar tidak memiliki lapisan pra-pemrosesan ini. Ia memperlakukan riwayat berharga Anda sebagai satu deretan karakter yang sangat panjang dan membingungkan.

Langkah 5: Bagaimana cara memilih alat yang tepat untuk ringkasan narasi?

Jika Anda menginginkan rincian percakapan Anda yang mendetail dan menghibur tanpa rekayasa prompt manual, Anda memerlukan aplikasi yang dibuat khusus untuk alur kerja tersebut. Wrapped AI Chat Analysis Recap dirancang tepat untuk tujuan itu. Aplikasi ini mengambil file teks yang diekspor, menerapkan segmentasi konteks yang diperlukan, dan menghasilkan rekap terstruktur yang menonjolkan lelucon internal, perilaku peserta, dan tren percakapan.

Bekerja sama erat dengan tim infrastruktur di Dynapps LTD, saya mengamati bahwa pengguna lebih menyukai output visual seperti cerita daripada tabel statistik mentah. Anda tidak hanya ingin tahu bahwa Anda mengirim 4.000 pesan; Anda ingin tahu apa arti pesan-pesan tersebut bagi dinamika grup Anda. Alat rekap khusus menangani kompleksitas komputasi, memformat output menjadi wawasan yang mudah dicerna dan dibagikan.

Tanya Jawab Praktis: Apa lagi yang harus Anda pertimbangkan sebelum mengunggah?

Untuk melengkapi proses ini, saya merangkum jawaban atas pertanyaan teknis yang paling sering saya terima terkait ekspor chat:

Apakah ukuran file berpengaruh?

Ya. Jika file teks Anda di atas 20MB, biasanya file tersebut berisi lampiran media bertahun-tahun (meskipun hanya label teks) atau log sistem yang berat. Alat khusus akan membagi data ini secara otomatis, sedangkan antarmuka Gemini atau ChatGPT standar sering kali akan menolak unggahan atau memotong file tersebut.

Mengapa ringkasan saya terlihat generik di chatbot standar?

Karena model AI umum secara default menggunakan nada netral dan informatif. Aplikasi khusus menerapkan perintah berbasis kepribadian yang telah dikonfigurasi sebelumnya ke data yang tersegmentasi, menghasilkan ringkasan yang menarik dan sadar budaya yang benar-benar terdengar seperti interaksi antar teman manusia.

Apakah mengganti perangkat akan memengaruhi ekspor?

Biasanya tidak. Selama aplikasi pesan menghasilkan ekspor TXT atau ZIP standar dari log teks Anda, mesin pengurai (parsing engine) yang dibangun dengan benar akan membaca stempel waktu dan string teks secara akurat, terlepas dari sistem operasinya.

Memproses riwayat komunikasi Anda seharusnya tidak memerlukan gelar dalam ilmu data. Dengan memahami keterbatasan alat umum dan memanfaatkan infrastruktur khusus, Anda dapat mengubah pesan kacau selama bertahun-tahun menjadi wawasan yang jelas dan menghibur.