5年分にも及ぶ親友とのチャット履歴をダウンロードしたと想像してみてください。そこには内輪ネタや深夜の議論、そして何千ものバラバラなタイムスタンプが詰まった15MBのファイルがあります。最初のまとまりを汎用的な対話型AIに貼り付け、面白い要約を期待したとします。しかし、システムはクラッシュするか、誰が話しているのかを見失うか、あるいは実際には存在しなかった会話を捏造し始めます。現在、汎用言語モデルから専用の計測アーキテクチャへの移行が、この問題を解決しようとしています。ユーザーは標準的なAIチャットボットに頼るのではなく、大規模なテキストエクスポートを安全に処理し、文脈を失うことなく構造化された物語を抽出する専用の「振り返り(リキャップ)」アプリへとシフトしています。

バックエンドエンジニアとしての私の日常業務は、クラウドベースの通信サービスやAPI連携の構築です。常に構造化されていない生のデータ(RAWデータ)を扱っています。生のチャットログを標準的な言語モデルに読み込ませるのは簡単な作業だと思われがちですが、実際はそうではありません。チャット履歴は乱雑で非線形的、かつ密度が高いものです。メッセージ履歴から実際の価値を引き出すには、データ処理に対する体系的なアプローチが必要です。

ステップ1:なぜメッセージング習慣に高度な技術基盤が求められているのか?

データの解析を試みる前に、問題の規模を理解することが役立ちます。私たちはかつてないほど多くの会話データを生成しています。最近のモバイル業界のデータによると、世界のアプリセッション数と消費支出は記録的な高水準を維持しており、モバイル・エンゲージメントの深化を物語っています。デジタルインタラクションが深まるにつれ、デバイス内に蓄積されるテキストデータの量は指数関数的に増加しています。

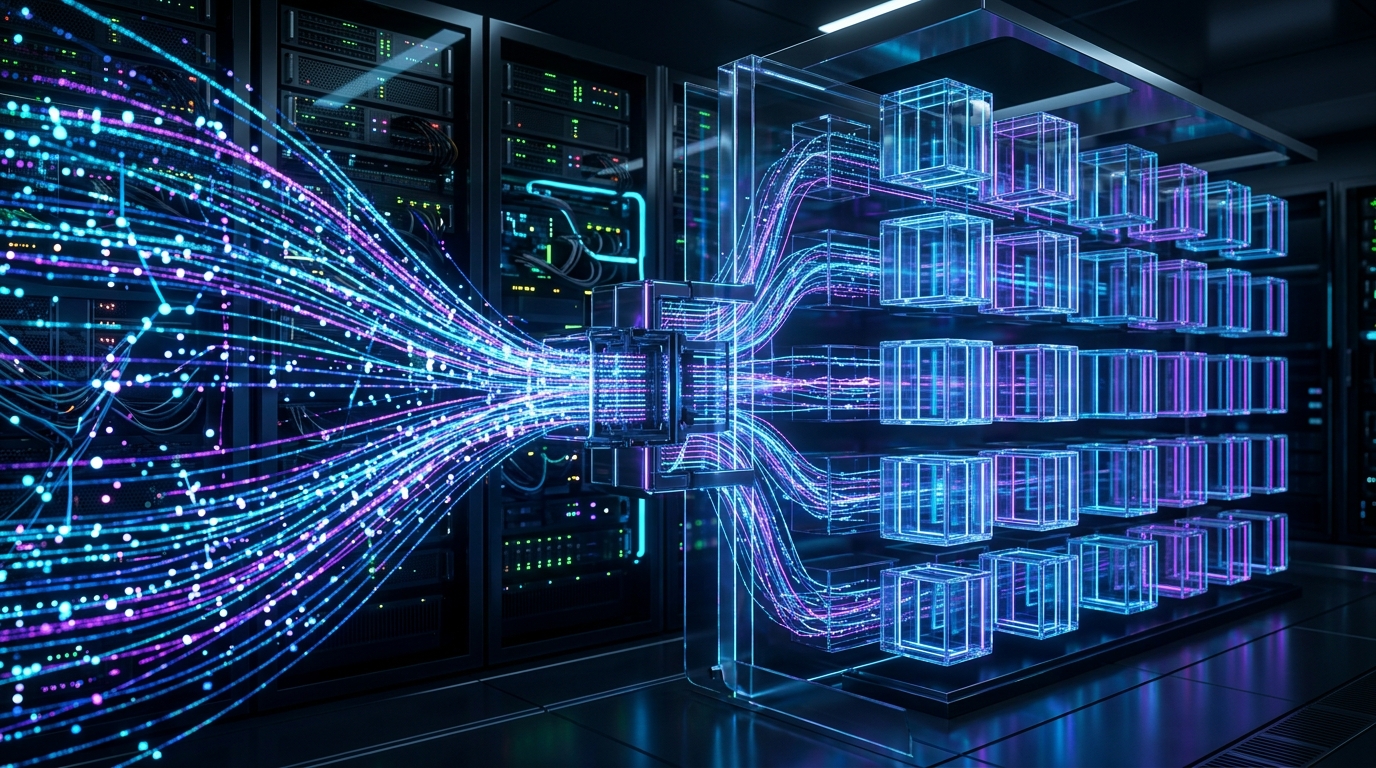

最近のトレンドは「AI + 計測アーキテクチャ」への極めて重要なシフトを示しています。これはデータの扱い方における根本的な変化を意味します。人工知能はもはや単なる対話ツールではなく、複雑なデータセグメンテーションやエンドツーエンドの処理に使用される基盤インフラになりつつあります。自身のコミュニケーションパターンを分析したいのであれば、単なる空白のプロンプト入力欄ではなく、このような専用アーキテクチャの上に構築されたツールが必要になります。

この段階でのヒント: 実際のゴールを定義しましょう。このアプローチは、個人のチャットエクスポートを楽しく構造化された要約に変えたい個人、友人、小規模なチームを特に対象としています。自動カスタマーサポートのパイプラインを構築しようとしている企業のCRMデータアナリスト向けではありません。

ステップ2:なぜ一般的なプラットフォームでは文脈の保持が困難なのか?

私はバックエンド分析システムに届くルーティングクエリを頻繁に確認しています。解決策を探している人々は、アプリストアで「cha t gpt」「chat gp t」、あるいは「wchat gpt」といったバリエーションを入力することがよくあります。ユーザーが「chàt gpt」や「gbt char」と検索していても、あるいは「DeepSeek」や「Grok AI」のようなインターフェースを試していても、根本的な問題は同じです。それは「トークン制限」です。

すべてのAIチャットシステムは、テキストを「トークン」単位で処理します。大規模なWhatsAppなどのメッセージログを汎用的なGPTチャットに貼り付けると、モデルはタイムスタンプ、名前、システムメッセージ(「画像を省略しました」など)をすべてトークンとして読み取ります。すると、すぐにメモリ容量の限界に達してしまいます。1月のメッセージを読み終える頃には、11月に何が起きたかをすでに忘れてしまっています。その結果、物語の整合性が崩壊するのです。

さらに、汎用モデルは質問に答えるように訓練されており、生のJSONやTXTファイルのデータアナリストとして機能するようには設計されていません。グループチャットによく見られるスラングや激しい文脈の切り替わりに遭遇すると、AIはハルシネーション(もっともらしい嘘)を起こします。モデルが分析を開始する前に、ノイズを取り除くための専用インフラが必要なのです。

ステップ3:適切なプライバシーと処理のフレームワークをどう特定するか?

個人のメッセージングデータをエクスポートする際は、厳格なプライバシーへの考慮が必要です。1年分の個人的なやり取りをアップロードする場合、ツールのデータ取り扱いポリシーを評価しなければなりません。

このタスクのためにアプリケーションを選択する際は、以下の基準を使用してください:

- データの即時破棄(Data Ephemerality): アプリケーションはメッセージを永続的に保存しますか? それとも分析完了後すぐに生のテキストを破棄しますか?

- プラットフォームへの特化: メッセージングアプリからエクスポートされた特定の形式をネイティブに読み取り、メッセージの終わりと返信の始まりを正しく認識できますか?

- 出力形式: 単なるテキストの羅列を提供しますか? それとも(「Wrapped」スタイルのような)視覚的に魅力的な要約を提供しますか?

汎用ツールは、将来のモデル学習のためにユーザーの入力を利用することがよくあります。専用ツールはセッションデータを隔離すべきです。データ同意への関心の高まりは市場全体で明らかです。App Tracking Transparency (ATT) に関するレポートでは、ユーザーが自身のデータの行き先に対して以前よりも慎重になっていることが示されています。分析ツールの選択にもその慎重さを反映させるべきです。

ステップ4:深い文脈のセグメンテーションによるメリットとは?

エンジニアリングの観点から見ると、大規模なテキストファイルを処理する鍵は「深い文脈のセグメンテーション(断片化)」にあります。ファイル全体を1つのプロンプトに無理やり詰め込むのではなく、適切に設計されたシステムは、時間的な空白やトピックの切り替わりに基づいてドキュメントを論理的なブロックに分割します。

汎用AIの要約では個人のメッセージからニュアンスが削ぎ落とされがちですが、セグメンテーションアルゴリズムはまず参加者同士の関係性をマッピングします。誰が主な話し手か、どのフレーズが最も頻繁に使われるか、活動のピークはいつかを特定します。これらのメタデータが構造化された後、初めて整理されたブロックが物語生成のためにAIチャットのバックエンドに渡されます。

「chats gpt」や「chatgtp」と検索してもフラストレーションが溜まることが多いのはこのためです。標準的なウェブインターフェースには、この前処理レイヤーが欠けています。貴重な履歴を、単なる圧倒的な文字の羅列として扱ってしまうのです。

ステップ5:ナラティブな要約を作成するための適切なツールの選び方

手動でプロンプトエンジニアリングを行わずに、会話の詳細で面白い分析結果を得るには、そのワークフロー専用に構築されたアプリケーションが必要です。「Wrapped AI Chat Analysis Recap」は、まさにその目的のために設計されています。エクスポートされたテキストファイルを受け取り、必要な文脈セグメンテーションを適用して、内輪ネタ、参加者の行動、会話のトレンドを強調した構造化された要約を生成します。

Dynapps LTD のインフラチームと密接に連携する中で、私はユーザーが生の統計表よりも、視覚的でストーリー性のある出力を好むことを目の当たりにしてきました。単に「4,000件のメッセージを送った」ことを知りたいのではありません。それらのメッセージがグループのダイナミクスについて何を物語っているかを知りたいのです。専用の振り返りツールは、計算上の複雑さを処理し、共有しやすく理解しやすい洞察としてフォーマットしてくれます。

実践的なQ&A:アップロード前に考慮すべき点は?

最後に、チャットエクスポートに関して私がよく受ける技術的な質問への回答をまとめました。

ファイルサイズは重要ですか?

はい。テキストファイルが20MBを超える場合、通常、数年分のメディア添付ファイルの情報(テキストとして「省略」と記載されていても)や大量のシステムログが含まれています。専用ツールはこれらのデータを自動的に分割(チャンク化)しますが、標準的なGeminiやChatGPTのインターフェースでは、アップロードが拒否されたりファイルが途中で切り捨てられたりすることがよくあります。

標準的なチャットボットでの要約が味気ないのはなぜですか?

汎用AIモデルは、デフォルトで中立的かつ情報提供的なトーンになるように設定されているためです。専用アプリは、セグメント化されたデータに対して事前に設定された性格重視のプロンプトを適用します。その結果、人間の友人間のような、文化的背景を汲み取った魅力的な要約が得られるのです。

デバイスを変更するとエクスポートに影響しますか?

通常、影響はありません。メッセージングアプリが標準的なTXTまたはZIP形式でログを生成する限り、適切に構築された解析エンジンは、OSに関係なくタイムスタンプとテキスト文字列を正確に読み取ります。

コミュニケーション履歴の処理に、データサイエンスの学位は必要ありません。汎用ツールの限界を理解し、専用のインフラを活用することで、長年の混沌としたメッセージを明快で楽しい洞察に変えることができるのです。