Stellen Sie sich vor, Sie laden einen fünfjährigen Chatverlauf mit Ihren engsten Freunden herunter. Sie halten eine 15 MB große Datei in den Händen, gefüllt mit Insider-Witzen, nächtlichen Diskussionen und tausenden fragmentierten Zeitstempeln. Sie kopieren den ersten Teil in eine gängige KI-Schnittstelle, in der Hoffnung auf eine unterhaltsame Zusammenfassung. Stattdessen stürzt das System ab, verliert den Überblick, wer gerade spricht, oder erfindet Gespräche, die nie stattgefunden haben. Aktuell löst der Übergang von generischen Sprachmodellen zu spezialisierter Messarchitektur genau dieses Problem. Anstatt sich auf Standard-KI-Chatbots zu verlassen, wechseln Nutzer zu zweckgebundenen Recap-Apps, die massive Textexporte sicher verarbeiten und strukturierte Narrative extrahieren, ohne den Kontext zu verlieren.

Meine tägliche Arbeit als Backend-Entwickler umfasst die Strukturierung von cloudbasierten Kommunikationsdiensten und API-Integrationen. Ich habe ständig mit unstrukturierten Rohdaten zu tun. Viele nehmen an, dass das Einspeisen eines Chat-Protokolls in ein Standard-Sprachmodell eine einfache Aufgabe ist. Das ist es nicht. Chatverläufe sind chaotisch, nicht linear und extrem dicht. Um tatsächlichen Wert aus Ihrer Nachrichten-Historie zu ziehen, benötigen Sie einen methodischen Ansatz zur Datenverarbeitung.

Schritt 1: Warum erfordern unsere Messaging-Gewohnheiten eine bessere technische Infrastruktur?

Bevor Sie versuchen, Ihre eigenen Daten zu parsen, hilft es, das Ausmaß des Problems zu verstehen. Wir generieren mehr Konversationsdaten als je zuvor. Laut aktuellen Mobilfunkdaten erreichen globale App-Sitzungen und Verbraucherausgaben weiterhin Rekordhöhen, was die Tiefe der mobilen Interaktion unterstreicht. Da unsere digitalen Interaktionen immer intensiver werden, ist das Volumen der Textdaten auf unseren Geräten exponentiell gewachsen.

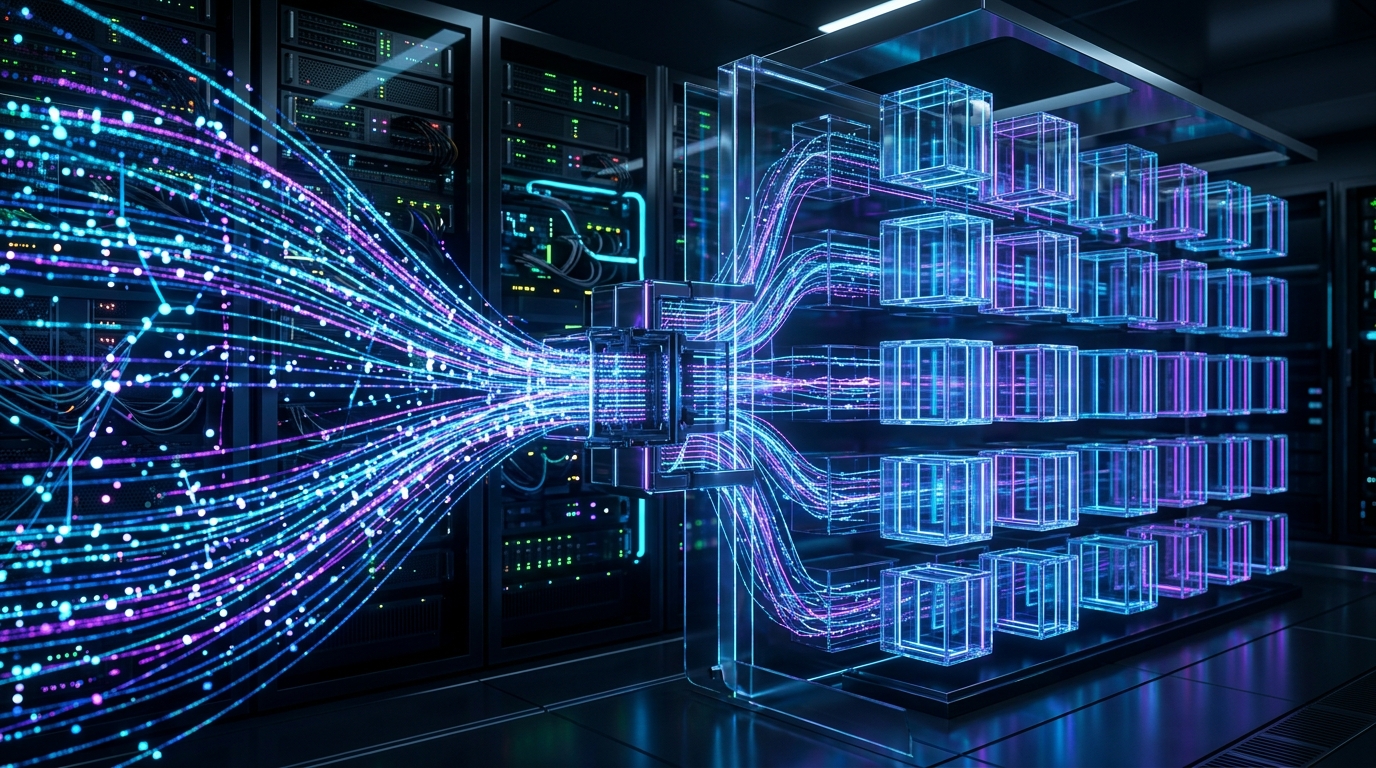

Aktuelle Trends deuten auf einen entscheidenden Wandel hin zu „KI + Messarchitektur“ hin. Dies markiert eine grundlegende Änderung im Umgang mit Daten. Künstliche Intelligenz ist nicht mehr nur ein eigenständiges Tool, mit dem man chattet; sie wird zur Basisinfrastruktur für komplexe Datensegmentierung und End-to-End-Verarbeitung. Wenn Sie Ihre Kommunikationsmuster analysieren wollen, benötigen Sie Werkzeuge, die auf einer solchen dedizierten Architektur basieren, und nicht nur ein leeres Textfeld.

Tipp für diese Phase: Definieren Sie Ihr eigentliches Ziel. Dieser Ansatz richtet sich speziell an Einzelpersonen, Freunde und kleine Teams, die ihre persönlichen Chat-Exporte in unterhaltsame, strukturierte Zusammenfassungen verwandeln möchten. Er ist NICHT für CRM-Datenanalysten in Unternehmen gedacht, die automatisierte Kundensupport-Pipelines aufbauen wollen.

Schritt 2: Warum scheitern allgemeine Plattformen an der Kontext-Erhaltung?

Ich überprüfe regelmäßig die Routing-Abfragen, die in Backend-Analysesystemen eingehen. Nutzer, die nach Lösungen suchen, tippen oft Varianten wie cha t gpt, chat gp t oder sogar wchat gpt in App-Stores ein. Egal, ob ein Nutzer nach chàt gpt, gbt char sucht oder Interfaces wie deepseek und grok ai testet – das grundlegende Problem bleibt dasselbe: Token-Limits.

Jedes KI-Chat-System verarbeitet Text in „Token“. Wenn Sie ein großes WhatsApp-Messenger-Protokoll in einen generischen GPT-Chat einfügen, liest das Modell die Zeitstempel, die Namen und die Systemmeldungen (wie „Bild weggelassen“) als Token. Es erreicht schnell seine Speicherkapazität. Bis es die Nachrichten vom Januar liest, hat es bereits vergessen, was im November passiert ist. Die Erzählstruktur bricht zusammen.

Darüber hinaus sind Allzweckmodelle darauf trainiert, Fragen zu beantworten, und nicht als Datenanalysten für rohe JSON- oder TXT-Dateien zu fungieren. Wenn sie auf Slang oder häufige Themenwechsel stoßen – typisch für Gruppenchats –, beginnen sie zu halluzinieren. Spezialisierte Infrastruktur ist erforderlich, um das Rauschen herauszufiltern, bevor das Modell überhaupt mit der Analyse beginnt.

Schritt 3: Wie identifiziert man das richtige Framework für Datenschutz und Verarbeitung?

Der Export persönlicher Messaging-Daten erfordert strenge Datenschutzüberlegungen. Wenn Sie die persönlichen Interaktionen eines ganzen Jahres hochladen, müssen Sie die Richtlinien zum Umgang mit Daten des jeweiligen Tools genau prüfen.

Achten Sie bei der Auswahl einer Anwendung auf diese Kriterien:

- Daten-Ephemerität: Speichert die Anwendung Ihre Nachrichten dauerhaft oder verwirft sie den Rohtext sofort nach Abschluss der Analyse?

- Plattformspezifität: Kann sie das spezifische Format Ihrer Messaging-App nativ lesen und erkennen, wo eine Nachricht endet und eine Antwort beginnt?

- Ausgabeformat: Liefert sie eine flache Textwand oder eine visuell ansprechende Zusammenfassung (ähnlich einem „Wrapped“-Stil)?

Generische Tools nutzen Ihre Eingaben oft, um zukünftige Modelle zu trainieren. Ein dediziertes Tool sollte Ihre Sitzungsdaten isolieren. Der wachsende Fokus auf Dateneinwilligung ist im breiteren Markt deutlich erkennbar; Berichte zur App-Tracking-Transparenz (ATT) zeigen, dass Nutzer wesentlich bewusster entscheiden, wohin ihre Daten fließen. Ihre Wahl der Analysetools sollte diese Vorsicht widerspiegeln.

Schritt 4: Was ist der Vorteil tiefer Kontext-Segmentierung?

Aus technischer Sicht ist die Lösung zur Verarbeitung massiver Textdateien die tiefe Kontext-Segmentierung. Anstatt eine gesamte Datei in einen einzigen Prompt zu zwingen, unterteilt ein gut architekturiertes System das Dokument in logische Blöcke, basierend auf Zeitabständen oder Themenwechseln.

Während generische KI-Zusammenfassungen oft die Nuancen persönlicher Nachrichten entfernen, bilden Segmentierungsalgorithmen zuerst die Beziehungen zwischen den Teilnehmern ab. Sie identifizieren, wer die Hauptsprecher sind, welche Phrasen am häufigsten verwendet werden und wann die Spitzenaktivität auftritt. Erst nachdem diese Metadaten strukturiert sind, übergibt das System die organisierten Blöcke an das KI-Backend zur Generierung des Narrativs.

Dies ist der Grund, warum die Suche nach chats gpt oder chatgtp meist zu Enttäuschungen führt. Dem Standard-Webinterface fehlt schlichtweg diese Vorverarbeitungsschicht. Es behandelt Ihren wertvollen Verlauf als eine einzige, überwältigende Zeichenfolge.

Schritt 5: Wie wählt man das richtige Tool für narrative Zusammenfassungen aus?

Wenn Sie eine detaillierte, unterhaltsame Analyse Ihrer Gespräche ohne manuelle Prompt-Erstellung wünschen, benötigen Sie eine Anwendung, die speziell für diesen Workflow entwickelt wurde. Wrapped AI Chat Analysis Recap wurde genau für diesen Zweck entwickelt. Es nimmt die exportierte Textdatei auf, wendet die notwendige Kontext-Segmentierung an und generiert ein strukturiertes Recap, das Insider-Witze, Teilnehmerverhalten und Konversationstrends hervorhebt.

Durch die enge Zusammenarbeit mit Infrastrukturteams bei Dynapps LTD habe ich beobachtet, dass Nutzer visuelle, geschichtenähnliche Ausgaben gegenüber reinen statistischen Tabellen bevorzugen. Sie wollen nicht nur wissen, dass Sie 4.000 Nachrichten gesendet haben; Sie wollen wissen, was diese Nachrichten über die Dynamik Ihrer Gruppe aussagen. Ein dediziertes Recap-Tool übernimmt die rechnerische Komplexität und formatiert das Ergebnis in teilbare, leicht verständliche Einblicke.

Praktische Q&A: Was sollten Sie vor dem Upload noch beachten?

Um diesen Prozess abzurunden, habe ich Antworten auf die häufigsten technischen Fragen zusammengestellt, die ich zu Chat-Exporten erhalte:

Spielt die Dateigröße eine Rolle?

Ja. Wenn Ihre Textdatei über 20 MB groß ist, enthält sie meist jahrelange Medienanhänge (selbst wenn diese nur als Platzhaltertext markiert sind) oder umfangreiche Systemprotokolle. Spezialisierte Tools zerlegen diese Daten automatisch, während ein Standard-Interface wie Gemini oder ChatGPT den Upload oft ablehnt oder die Datei kürzt.

Warum sieht meine Zusammenfassung in Standard-Chatbots so generisch aus?

Weil allgemeine KI-Modelle standardmäßig einen neutralen, informativen Ton verwenden. Eine spezialisierte App wendet vorkonfigurierte, charakterbasierte Prompts auf die segmentierten Daten an. Das Ergebnis ist eine ansprechende, kulturell bewusste Zusammenfassung, die tatsächlich so klingt, wie Freunde miteinander interagieren.

Beeinflusst ein Gerätewechsel den Export?

Normalerweise nicht. Solange die Messaging-App einen standardmäßigen TXT- oder ZIP-Export Ihrer Protokolle generiert, wird eine korrekt aufgebaute Parsing-Engine die Zeitstempel und Textzeichenfolgen unabhängig vom Betriebssystem korrekt auslesen.

Die Verarbeitung Ihrer Kommunikationshistorie sollte kein Informatikstudium erfordern. Indem Sie die Grenzen allgemeiner Tools verstehen und zweckgebundene Infrastruktur nutzen, können Sie Jahre chaotischer Nachrichten in klare, unterhaltsame Erkenntnisse verwandeln.