Stel je voor: je downloadt een chatgeschiedenis van vijf jaar met je beste vrienden. Je hebt een bestand van 15 MB in handen vol inside jokes, nachtelijke discussies en duizenden gefragmenteerde tijdstempels. Je kopieert het eerste deel naar een standaard AI-chatbot in de hoop op een leuke samenvatting. In plaats daarvan loopt het systeem vast, verliest het de draad van wie wat zegt, of verzint het gesprekken die nooit hebben plaatsgevonden. Momenteel lost de overgang van generieke taalmodellen naar gespecialiseerde meetarchitectuur precies dit probleem op. In plaats van te vertrouwen op een standaard AI-chatbot, stappen gebruikers over naar specifiek gebouwde recap-apps die enorme tekst-exports veilig verwerken en gestructureerde verhalen extraheren zonder context te verliezen.

Mijn dagelijkse werk als backend-ontwikkelaar bestaat uit het structureren van cloudgebaseerde communicatiediensten en API-integraties. Ik werk constant met ruwe, ongestructureerde data. Mensen gaan er vaak vanuit dat het invoeren van een ruw chatlogboek in een standaard taalmodel eenvoudig is. Dat is het niet. Chatgeschiedenissen zijn rommelig, niet-lineair en compact. Om echt waarde uit je chatgeschiedenis te halen, heb je een methodische aanpak voor gegevensverwerking nodig.

Stap 1: Waarom onze chatgewoonten om een betere technische infrastructuur vragen?

Voordat je probeert je eigen data te parsen, is het nuttig om de omvang van het probleem te begrijpen. We genereren meer gespreksdata dan ooit tevoren. Volgens recente gegevens uit de mobiele industrie blijven wereldwijde app-sessies en consumentenbestedingen recordhoogtes bereiken, wat de diepgang van mobiele betrokkenheid benadrukt. Naarmate onze digitale interacties intensiever worden, is de enorme hoeveelheid tekstdata op onze apparaten exponentieel gegroeid.

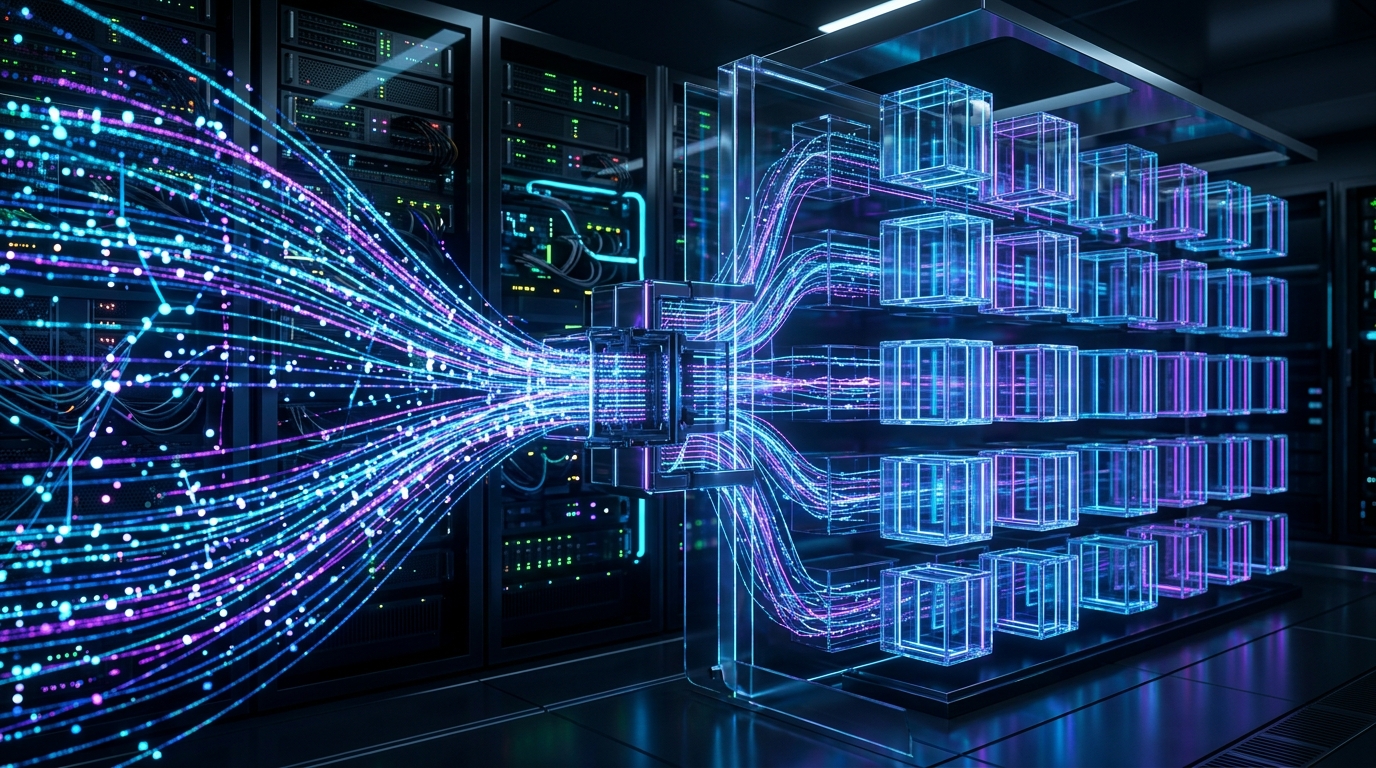

Recente trends wijzen op een cruciale verschuiving naar "AI + meetarchitectuur". Dit duidt op een fundamentele verandering in de manier waarop we met data omgaan. Kunstmatige intelligentie is niet langer alleen een losse tool waar je mee chat; het wordt de fundamentele infrastructuur die wordt gebruikt voor complexe datasegmentatie en end-to-end verwerking. Als je je communicatiepatronen wilt analyseren, heb je tools nodig die op dit soort toegewijde architectuur zijn gebouwd, niet alleen een leeg tekstveld.

Tip voor deze fase: Definieer je werkelijke doel. Deze aanpak is specifiek bedoeld voor individuen, vrienden en kleine teams die hun persoonlijke chat-exports willen omzetten in vermakelijke, gestructureerde samenvattingen. Het is NIET bedoeld voor CRM-data-analisten in grote bedrijven die geautomatiseerde klantenservice-pijplijnen willen bouwen.

Stap 2: Waarom falen algemene platforms bij contextbehoud?

Ik bekijk regelmatig de zoekopdrachten die binnenkomen bij backend-analysesystemen. Mensen die naar oplossingen zoeken, typen vaak varianten zoals cha t gpt, chat gp t of zelfs wchat gpt in app-stores. Of een gebruiker nu zoekt op chàt gpt, gbt char, of interfaces test zoals deepseek en grok ai, het fundamentele probleem blijft hetzelfde: token-limieten.

Elk AI-chatsysteem verwerkt tekst in "tokens". Wanneer je een groot WhatsApp-logboek in een generieke GPT-chat plakt, leest het model de tijdstempels, de namen en de systeemberichten (zoals "Afbeelding weggelaten") als tokens. Het bereikt snel zijn geheugencapaciteit. Tegen de tijd dat het de berichten van januari leest, is het al vergeten wat er in november is gebeurd. Het verhaal stort in.

Bovendien zijn algemene modellen getraind om vragen te beantwoorden, niet om te fungeren als data-analisten voor ruwe JSON- of TXT-bestanden. Wanneer ze straattaal of snelle contextwisselingen tegenkomen — wat typisch is voor groepsapps — gaan ze hallucineren. Gespecialiseerde infrastructuur is vereist om de ruis weg te filteren voordat het model überhaupt met de analyse begint.

Stap 3: Hoe identificeer je het juiste kader voor privacy en verwerking?

Het exporteren van persoonlijke chatgegevens vereist strikte privacyoverwegingen. Als je de persoonlijke interacties van een heel jaar uploadt, moet je het gegevensverwerkingsbeleid van de tool evalueren.

Gebruik deze criteria bij het selecteren van een applicatie voor deze taak:

- Data-ephemeraliteit: Slaat de applicatie je berichten permanent op, of verwijdert deze de ruwe tekst onmiddellijk nadat de analyse is voltooid?

- Platformspecificiteit: Kan de tool systeemeigen het specifieke formaat lezen dat door je berichten-app is geëxporteerd, en herkent het waar een bericht eindigt en een antwoord begint?

- Output-formaat: Biedt het een saaie lap tekst, of een visueel aantrekkelijke samenvatting (zoals een "Wrapped" stijl overzicht)?

Generieke tools gebruiken je invoer vaak om toekomstige modellen te trainen. Een toegewijde tool moet je sessiegegevens isoleren. De groeiende focus op toestemming voor gegevensgebruik is duidelijk in de bredere markt; rapporten over App Tracking Transparency (ATT) laten zien dat gebruikers steeds bewuster worden over waar hun data naartoe gaat. Je keuze voor analysetools moet die voorzichtigheid weerspiegelen.

Stap 4: Wat is het voordeel van diepe context-segmentatie?

Vanuit een technisch perspectief is de oplossing voor het verwerken van enorme tekstbestanden diepe context-segmentatie. In plaats van een heel bestand in één prompt te dwingen, verdeelt een goed ontworpen systeem het document in logische blokken op basis van tijdsintervallen of onderwerpverschuivingen.

Terwijl generieke AI-samenvattingen vaak de nuance uit persoonlijke berichten halen, brengen segmentatie-algoritmen eerst de relaties tussen deelnemers in kaart. Ze identificeren wie de belangrijkste sprekers zijn, welke zinnen het meest worden gebruikt en wanneer de piekactiviteit plaatsvindt. Pas nadat deze metadata is gestructureerd, geeft het systeem de georganiseerde blokken door aan de AI-backend voor het genereren van het verhaal.

Dit is waarom zoeken naar chats gpt of chatgtp meestal tot frustratie leidt. De standaard webinterface mist simpelweg deze laag van voorbewerking. Het behandelt je waardevolle geschiedenis als één enkele, overweldigende reeks tekens.

Stap 5: Hoe kies je de juiste tool voor verhalende samenvattingen?

Als je een gedetailleerd, vermakelijk overzicht van je gesprekken wilt zonder handmatige prompt-engineering, heb je een applicatie nodig die specifiek voor die workflow is gebouwd. Wrapped AI Chat Analysis Recap is ontworpen voor precies dat doel. Het neemt het geëxporteerde tekstbestand, past de nodige context-segmentatie toe en genereert een gestructureerde recap die inside jokes, gedrag van deelnemers en gesprekstrends benadrukt.

Door nauw samen te werken met infrastructuurteams bij Dynapps LTD, heb ik gemerkt dat gebruikers de voorkeur geven aan visuele, verhaalachtige outputs boven ruwe statistische tabellen. Je wilt niet alleen weten dat je 4.000 berichten hebt gestuurd; je wilt weten wat die berichten zeggen over de dynamiek van je groep. Een speciale recap-tool handelt de computationele complexiteit af en formatteert de resultaten in deelbare, begrijpelijke inzichten.

Praktische V&A: Waar moet je nog meer op letten voor het uploaden?

Ter afronding van dit proces heb ik antwoorden verzameld op de meest voorkomende technische vragen die ik krijg over chat-exports:

Maakt de bestandsgrootte uit?

Ja. Als je tekstbestand groter is dan 20 MB, bevat het meestal jaren aan media-bijlagen (zelfs als deze als weggelaten tekst worden aangeduid) of zware systeemlogs. Gespecialiseerde tools hakken deze data automatisch in stukken, terwijl een standaard Gemini- of ChatGPT-interface de upload vaak weigert of het bestand inkort.

Waarom ziet mijn samenvatting er zo generiek uit in standaard chatbots?

Omdat algemene AI-modellen standaard een neutrale, informatieve toon aannemen. Een gespecialiseerde app past vooraf geconfigureerde, persoonlijkheidsgedreven prompts toe op de gesegmenteerde data, wat resulteert in een boeiende, cultureel bewuste samenvatting die daadwerkelijk klinkt als interactie tussen menselijke vrienden.

Heeft het wisselen van toestel invloed op de export?

Meestal niet. Zolang de berichten-app een standaard TXT- of ZIP-export van je chatlogs genereert, zal een goed gebouwde parsing-engine de tijdstempels en tekstreeksen nauwkeurig lezen, ongeacht het besturingssysteem.

Het verwerken van je communicatiegeschiedenis zou geen diploma in datawetenschap moeten vereisen. Door de beperkingen van algemene tools te begrijpen en gebruik te maken van specifiek gebouwde infrastructuur, kun je jaren aan chaotische berichten omzetten in heldere, vermakelijke inzichten.