친한 친구들과 5년 동안 나눈 대화 기록을 다운로드한다고 상상해 보세요. 내부 필터링 없는 농담, 한밤중의 말다툼, 수만 개의 파편화된 타임스탬프로 가득 찬 15MB 용량의 파일이 여러분 손에 있습니다. 이를 일반적인 대화형 AI에 붙여넣어 재미있는 요약을 기대해 보지만, 시스템은 곧 멈춰버리거나, 누가 말하고 있는지 혼동하거나, 심지어 실제로는 없었던 대화를 지어내기도 합니다. 현재, 일반적인 언어 모델에서 전문화된 '측정 아키텍처'로의 전환이 바로 이 문제를 해결하고 있습니다. 사용자들은 이제 표준 AI 챗봇에 의존하는 대신, 대용량 텍스트를 안전하게 처리하고 문맥을 잃지 않으면서 구조화된 서사를 추출하도록 설계된 전용 리캡(Recap) 앱으로 눈을 돌리고 있습니다.

백엔드 개발자로서 저의 일상 업무는 클라우드 기반 통신 서비스와 API 통합을 구조화하는 것입니다. 저는 끊임없이 구조화되지 않은 원시 데이터(Raw data)를 다룹니다. 많은 사람이 가공되지 않은 채팅 로그를 표준 언어 모델에 입력하는 것이 간단한 작업이라고 생각하지만, 사실은 그렇지 않습니다. 채팅 기록은 무질서하고 비선형적이며 데이터 밀도가 매우 높습니다. 메시지 기록에서 실제 가치를 추출하려면 데이터 처리에 대한 체계적인 접근 방식이 필요합니다.

1단계: 왜 우리의 메시징 습관은 더 나은 기술적 인프라를 요구하는가?

데이터를 직접 파싱하기 전에 문제의 규모를 이해하는 것이 중요합니다. 우리는 그 어느 때보다 많은 대화 데이터를 생성하고 있습니다. 최근 모바일 산업 데이터에 따르면, 글로벌 앱 세션과 소비자 지출은 계속해서 사상 최고치를 경신하고 있으며, 이는 모바일 인게이지먼트가 얼마나 깊어졌는지를 잘 보여줍니다. 디지털 상호작용이 심화됨에 따라 우리 기기에 쌓이는 텍스트 데이터의 양도 기하급수적으로 늘어났습니다.

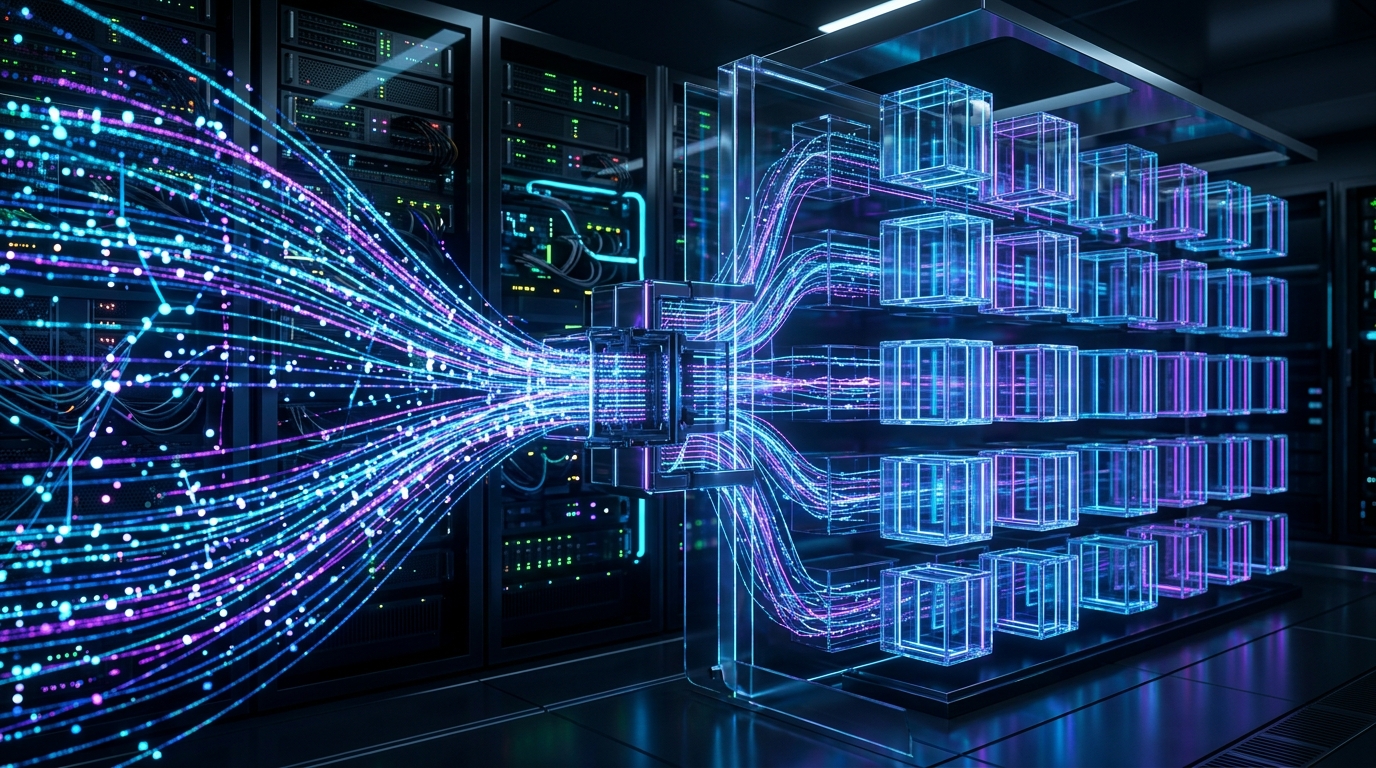

최근 트렌드는 'AI + 측정 아키텍처(Measurement Architecture)'로의 중대한 변화를 보여줍니다. 이는 우리가 데이터를 처리하는 방식의 근본적인 변화를 의미합니다. 인공지능은 더 이상 단순히 대화만 나누는 독립적인 도구가 아니라, 복잡한 데이터 세분화 및 엔드 투 엔드(end-to-end) 처리를 위한 기초 인프라가 되고 있습니다. 자신의 커뮤니케이션 패턴을 제대로 분석하고 싶다면 빈 텍스트 프롬프트가 아니라, 이러한 전용 아키텍처를 기반으로 구축된 도구가 필요합니다.

이 단계의 팁: 실제 목표를 설정하세요. 이 방식은 개인적인 채팅 내보내기 파일을 재미있고 구조화된 요약으로 바꾸고 싶은 개인, 친구, 소규모 팀에 최적화되어 있습니다. 자동화된 고객 지원 파이프라인을 구축하려는 기업용 CRM 데이터 분석가용은 아닙니다.

2단계: 왜 일반 플랫폼은 문맥 유지에 실패하는가?

저는 백엔드 분석 시스템으로 유입되는 쿼리들을 자주 검토합니다. 해결책을 찾는 사람들은 앱 스토어에서 cha t gpt, chat gp t, 또는 wchat gpt와 같은 변형된 키워드를 검색하곤 합니다. 사용자가 chàt gpt, gbt char를 검색하든, 혹은 deepseek이나 grok ai 같은 인터페이스를 테스트하든, 근본적인 문제는 동일합니다. 바로 '토큰 제한(Token limits)'입니다.

모든 AI 채팅 시스템은 텍스트를 '토큰' 단위로 처리합니다. 방대한 WhatsApp이나 카카오톡 대화 로그를 일반적인 GPT 채팅에 붙여넣으면, 모델은 타임스탬프, 이름, 시스템 메시지(예: "사진을 보냈습니다") 등을 모두 토큰으로 읽어 들입니다. 이로 인해 메모리 용량에 빠르게 도달하게 됩니다. AI가 1월의 메시지를 읽을 때쯤이면 이미 11월에 무슨 일이 있었는지 잊어버리게 되고, 전체적인 서사가 무너집니다.

또한, 범용 모델은 질문에 답하도록 훈련되었지 원시 JSON이나 TXT 파일을 분석하는 데이터 분석가로 설계되지 않았습니다. 그룹 채팅에서 흔히 나타나는 슬랭(비속어나 은어)이나 잦은 주제 전환을 만나면 모델은 할루시네이션(환각 현상)을 일으킵니다. 모델이 분석을 시작하기도 전에 소음을 필터링할 전문 인프라가 필수적인 이유입니다.

3단계: 적절한 개인정보 보호 및 처리 프레임워크를 식별하는 방법

개인적인 메시지 데이터를 내보낼 때는 엄격한 개인정보 보호 고려가 필요합니다. 1년 치의 개인적인 상호작용 데이터를 업로드한다면 해당 도구의 데이터 처리 정책을 반드시 평가해야 합니다.

이 작업을 위한 애플리케이션을 선택할 때는 다음 기준을 확인하세요:

- 데이터 휘발성(Data Ephemerality): 애플리케이션이 메시지를 영구적으로 저장합니까, 아니면 분석이 완료된 직후 원본 텍스트를 폐기합니까?

- 플랫폼 특화(Platform Specificity): 사용 중인 메시징 앱의 특정 내보내기 형식을 기본적으로 읽을 수 있으며, 메시지의 끝과 답장의 시작을 정확히 인식합니까?

- 출력 형식: 단순한 텍스트 뭉치를 제공합니까, 아니면 'Wrapped(연말 결산)' 스타일처럼 시각적으로 매력적인 요약을 제공합니까?

범용 도구들은 종종 사용자의 입력을 미래 모델 학습에 사용합니다. 전용 도구는 사용자의 세션 데이터를 격리해야 합니다. 앱 추적 투명성(ATT)에 대한 보고서에서 알 수 있듯이, 데이터 동의에 대한 사용자들의 관심은 그 어느 때보다 높습니다. 분석 도구 선택 시에도 이러한 주의가 반영되어야 합니다.

4단계: 심층 컨텍스트 세분화의 이점은 무엇인가?

엔지니어링 관점에서 대용량 텍스트 파일을 처리하는 해법은 '심층 컨텍스트 세분화(Deep context segmentation)'에 있습니다. 전체 파일을 하나의 프롬프트에 억지로 집어넣는 대신, 잘 설계된 시스템은 시간 간격이나 주제 전환을 기준으로 문서를 논리적 블록으로 나눕니다.

일반적인 AI 요약이 개인적인 메시지의 미묘한 뉘앙스를 놓치는 반면, 세분화 알고리즘은 먼저 참여자 간의 관계를 매핑합니다. 누가 주로 대화를 주도하는지, 어떤 구절이 가장 자주 사용되는지, 활동이 가장 활발한 시간대는 언제인지를 파악합니다. 이러한 메타데이터가 구조화된 후에야 시스템은 정리된 블록을 AI 채팅 백엔드로 전달하여 서사를 생성합니다.

이것이 바로 chats gpt나 chatgtp를 검색했을 때 실망스러운 결과가 나오는 이유입니다. 표준 웹 인터페이스에는 이러한 전처리 레이어(preprocessing layer)가 없습니다. 그저 여러분의 소중한 기록을 감당할 수 없을 정도로 긴 문자열로 취급할 뿐입니다.

5단계: 서사 요약을 위한 올바른 도구 선택법

수동 프롬프트 엔지니어링 없이 대화에 대한 상세하고 재미있는 분석을 원한다면, 해당 워크플로를 위해 특별히 제작된 애플리케이션이 필요합니다. Wrapped AI Chat Analysis Recap은 바로 그 목적을 위해 설계되었습니다. 이 도구는 내보낸 텍스트 파일을 받아 필요한 컨텍스트 세분화를 적용하고, 내부 농담, 참여자 행동, 대화 트렌드를 강조하는 구조화된 리캡을 생성합니다.

저는 Dynapps LTD의 여러 인프라 팀과 협업하며 사용자들이 가공되지 않은 통계 테이블보다 시각적이고 스토리텔링이 가미된 결과물을 선호한다는 점을 확인했습니다. 단순히 메시지를 4,000개 보냈다는 사실이 궁금한 것이 아니라, 그 메시지들이 그룹의 역동성에 대해 무엇을 말해주는지를 알고 싶어 하는 것이죠. 전용 리캡 도구는 복잡한 계산을 처리하고 결과를 공유하기 쉽고 이해하기 쉬운 인사이트로 변환해 줍니다.

실무 Q&A: 업로드 전 추가로 고려해야 할 사항

이 프로세스를 마무리하기 위해 채팅 내보내기와 관련하여 자주 받는 기술적 질문들을 정리했습니다.

파일 크기가 중요합니까?

네, 중요합니다. 텍스트 파일이 20MB를 초과한다면 수년간의 미디어 첨부 파일 기록(텍스트로만 표시되더라도)이나 과도한 시스템 로그가 포함되었을 가능성이 큽니다. 전용 도구는 이 데이터를 자동으로 청크(chunk)화하지만, 표준 Gemini나 ChatGPT 인터페이스는 업로드를 거부하거나 파일을 잘라낼 수 있습니다.

왜 표준 챗봇에서는 요약이 뻔하게 나옵니까?

일반 AI 모델은 중립적이고 정보 전달 위주의 어조를 기본값으로 사용하기 때문입니다. 특화된 앱은 세분화된 데이터에 미리 구성된 개성 있는 프롬프트를 적용하여, 실제 친구들이 대화하는 것처럼 재미있고 문화적 맥락이 살아있는 요약을 만들어냅니다.

기기를 변경하면 내보내기에 영향을 줍니까?

일반적으로는 아닙니다. 메시징 앱이 표준 TXT 또는 ZIP 형식으로 대화 로그를 생성하기만 하면, 운영 체제와 관계없이 잘 구축된 파싱 엔진이 타임스탬프와 텍스트 문자열을 정확하게 읽어낼 수 있습니다.

커뮤니케이션 기록을 처리하는 데 데이터 과학 학위가 필요하지는 않습니다. 일반적인 도구의 한계를 이해하고 목적에 맞게 구축된 인프라를 활용함으로써, 수년간의 혼란스러운 메시지를 명확하고 흥미로운 인사이트로 바꿀 수 있습니다.