Wyobraź sobie, że pobierasz historię wiadomości z ostatnich pięciu lat wymienionych z najbliższymi przyjaciółmi. Trzymasz w ręku plik o rozmiarze 15 MB, wypełniony wewnętrznymi żartami, nocnymi kłótniami i tysiącami pofragmentowanych sygnatur czasowych. Wklejasz pierwszy fragment do ogólnodostępnego interfejsu AI, licząc na zabawne podsumowanie. Zamiast tego system zawiesza się, gubi wątek tego, kto co powiedział, lub zmyśla rozmowy, które nigdy nie miały miejsca. Obecnie przejście od ogólnych modeli językowych do wyspecjalizowanej architektury pomiarowej rozwiązuje właśnie ten problem. Zamiast polegać na standardowym chatbocie AI, użytkownicy coraz częściej wybierają dedykowane aplikacje do podsumowań, które bezpiecznie przetwarzają ogromne eksporty tekstu i wyodrębniają ustrukturyzowane narracje bez utraty kontekstu.

Moja codzienna praca jako dewelopera backendu polega na strukturyzowaniu usług komunikacyjnych opartych na chmurze i integracji API. Stale mam do czynienia z surowymi, nieustrukturyzowanymi danymi. Ludzie zakładają, że wprowadzenie surowego logu czatu do standardowego modelu językowego to proste zadanie. Tak nie jest. Historie czatów są chaotyczne, nieliniowe i gęste. Aby wydobyć rzeczywistą wartość z historii wiadomości, potrzebujesz metodycznego podejścia do przetwarzania danych.

Krok 1: Dlaczego nasze nawyki komunikacyjne wymagają lepszej infrastruktury technicznej?

Zanim spróbujesz przeanalizować własne dane, warto zrozumieć skalę problemu. Generujemy więcej danych konwersacyjnych niż kiedykolwiek wcześniej. Według ostatnich danych z branży mobilnej, globalna liczba sesji w aplikacjach i wydatki konsumentów nadal osiągają rekordowe poziomy, co podkreśla głębię zaangażowania w kanały mobilne. W miarę jak nasze cyfrowe interakcje stają się coraz intensywniejsze, ilość danych tekstowych przechowywanych na naszych urządzeniach wzrosła wykładniczo.

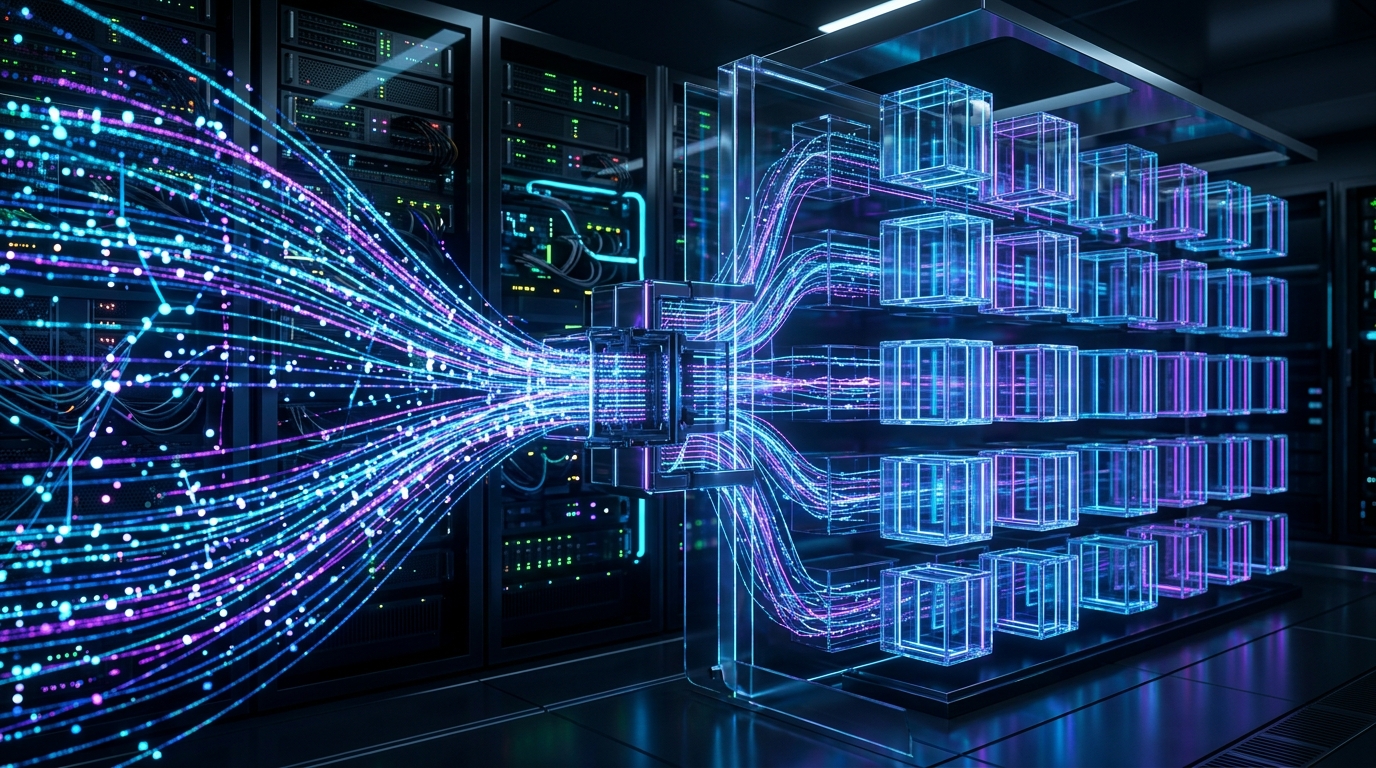

Ostatnie trendy wskazują na kluczową zmianę w kierunku „AI + Architektury Pomiarowej”. Oznacza to fundamentalną zmianę w sposobie obsługi danych. Sztuczna inteligencja nie jest już tylko samodzielnym narzędziem, z którym można porozmawiać; staje się fundamentem infrastruktury wykorzystywanej do złożonej segmentacji danych i kompleksowego przetwarzania. Jeśli chcesz przeanalizować swoje wzorce komunikacyjne, potrzebujesz narzędzi zbudowanych na tego rodzaju dedykowanej architekturze, a nie tylko pustego pola tekstowego.

Wskazówka na tym etapie: Zdefiniuj swój rzeczywisty cel. To podejście jest przeznaczone dla osób prywatnych, grup znajomych i małych zespołów, które chcą zamienić swoje osobiste eksporty czatów w zabawne, ustrukturyzowane podsumowania. NIE jest ono przeznaczone dla analityków danych CRM w przedsiębiorstwach, którzy chcą budować zautomatyzowane procesy obsługi klienta.

Krok 2: Dlaczego ogólne platformy zawodzą w zachowaniu kontekstu?

Często przeglądam zapytania trafiające do systemów analizy backendowej. Osoby szukające rozwiązań często wpisują w sklepach z aplikacjami warianty takie jak cha t gpt, chat gp t czy nawet wchat gpt. Niezależnie od tego, czy użytkownik szuka chàt gpt, gbt char, czy testuje interfejsy takie jak deepseek i grok ai, fundamentalny problem pozostaje ten sam: limity tokenów.

Każdy system czatu AI przetwarza tekst w postaci „tokenów”. Kiedy wklejasz duży log z WhatsAppa do ogólnego czatu GPT, model odczytuje sygnatury czasowe, nazwy użytkowników i komunikaty systemowe (takie jak „Obraz pominięty”) jako tokeny. Szybko osiąga swoją pojemność pamięci. Zanim doczyta wiadomości ze stycznia, zdąży już zapomnieć, co wydarzyło się w listopadzie. Narracja się rozpada.

Co więcej, modele ogólnego przeznaczenia są trenowane do odpowiadania na pytania, a nie do pełnienia roli analityków danych dla surowych plików JSON lub TXT. Gdy napotykają slang lub gwałtowne zmiany tematów — typowe w czatach grupowych — zaczynają halucynować. Wymagana jest specjalistyczna infrastruktura, która odfiltruje szum, zanim model w ogóle rozpocznie analizę.

Krok 3: Jak zidentyfikować właściwe ramy prywatności i przetwarzania?

Eksportowanie osobistych danych z komunikatorów wymaga rygorystycznego podejścia do prywatności. Jeśli przesyłasz historię osobistych interakcji z całego roku, musisz ocenić politykę obsługi danych danego narzędzia.

Wybierając aplikację do tego zadania, kieruj się następującymi kryteriami:

- Ulotność danych: Czy aplikacja przechowuje Twoje wiadomości na stałe, czy usuwa surowy tekst natychmiast po zakończeniu analizy?

- Specyfika platformy: Czy potrafi natywnie odczytać konkretny format wyeksportowany przez Twoją aplikację do przesyłania wiadomości, rozpoznając, gdzie kończy się jedna wiadomość, a zaczyna odpowiedź?

- Format wyjściowy: Czy dostarcza jedynie blok tekstu, czy wizualnie atrakcyjne podsumowanie (np. w stylu „Wrapped”)?

Ogólne narzędzia często wykorzystują wprowadzane dane do trenowania przyszłych modeli. Dedykowane narzędzie powinno izolować dane Twojej sesji. Rosnący nacisk na zgodę dotyczącą danych jest wyraźny na szerszym rynku; raporty dotyczące App Tracking Transparency (ATT) pokazują, że użytkownicy stają się znacznie bardziej rozważni w kwestii tego, gdzie trafiają ich dane. Twój wybór narzędzi analitycznych powinien odzwierciedlać tę ostrożność.

Krok 4: Jakie korzyści daje głęboka segmentacja kontekstu?

Z perspektywy inżynieryjnej rozwiązaniem problemu przetwarzania ogromnych plików tekstowych jest głęboka segmentacja kontekstu. Zamiast wtłaczać cały plik do jednego zapytania (promptu), dobrze zaprojektowany system dzieli dokument na logiczne bloki w oparciu o przerwy czasowe lub zmiany tematu.

Podczas gdy ogólne podsumowania AI często pozbawiają osobiste wiadomości niuansów, algorytmy segmentacji najpierw mapują relacje między uczestnikami. Identyfikują, kto mówi najwięcej, jakie frazy są używane najczęściej i kiedy występuje szczyt aktywności. Dopiero po ustrukturyzowaniu tych metadanych system przekazuje zorganizowane bloki do backendu sztucznej inteligencji w celu wygenerowania narracji.

Właśnie dlatego wyszukiwanie haseł takich jak chats gpt lub chatgtp zazwyczaj kończy się frustracją. Standardowy interfejs webowy po prostu nie posiada tej warstwy wstępnego przetwarzania. Traktuje Twoją cenną historię jako pojedynczy, przytłaczający ciąg znaków.

Krok 5: Jak wybrać odpowiednie narzędzie do podsumowań narracyjnych?

Jeśli chcesz szczegółowego, zabawnego zestawienia swoich rozmów bez ręcznego tworzenia skomplikowanych zapytań, potrzebujesz aplikacji zbudowanej specjalnie dla tego procesu. Wrapped AI Chat Analysis Recap został zaprojektowany właśnie w tym celu. Pobiera wyeksportowany plik tekstowy, stosuje niezbędną segmentację kontekstu i generuje ustrukturyzowane podsumowanie, które podkreśla wewnętrzne żarty, zachowania uczestników i trendy w konwersacjach.

Współpracując blisko z zespołami infrastruktury w Dynapps LTD, zauważyłem, że użytkownicy wolą wizualne wyjścia w formie opowieści niż surowe tabele statystyczne. Nie chcesz tylko wiedzieć, że wysłałeś 4000 wiadomości; chcesz wiedzieć, co te wiadomości mówią o dynamice Twojej grupy. Dedykowane narzędzie do podsumowań bierze na siebie złożoność obliczeniową, formatując wynik w czytelne i możliwe do udostępnienia spostrzeżenia.

Praktyczne Q&A: Co jeszcze warto wziąć pod uwagę przed przesłaniem danych?

Aby sfinalizować ten proces, zebrałem odpowiedzi na najczęstsze pytania techniczne dotyczące eksportu czatów:

Czy rozmiar pliku ma znaczenie?

Tak. Jeśli Twój plik tekstowy ma ponad 20 MB, zazwyczaj zawiera wieloletnią historię z załącznikami multimedialnymi (nawet jeśli są oznaczone jako pominięty tekst) lub obszerne logi systemowe. Specjalistyczne narzędzia automatycznie dzielą te dane na mniejsze fragmenty, podczas gdy standardowy interfejs Gemini lub ChatGPT często odrzuci plik lub go utnie.

Dlaczego moje podsumowanie w standardowych chatbotach wygląda tak bezbarwnie?

Ponieważ ogólne modele AI domyślnie przyjmują neutralny, informacyjny ton. Specjalistyczna aplikacja stosuje wstępnie skonfigurowane, oparte na osobowości prompty do posegmentowanych danych, co daje w rezultacie angażujące, świadome kulturowo podsumowanie, które faktycznie brzmi jak rozmowa grupy przyjaciół.

Czy zmiana urządzenia wpłynie na eksport?

Zazwyczaj nie. Dopóki aplikacja do przesyłania wiadomości generuje standardowy eksport TXT lub ZIP z Twoimi logami tekstowymi, odpowiednio zbudowany silnik analizujący dokładnie odczyta sygnatury czasowe i ciągi tekstowe, niezależnie od systemu operacyjnego.

Przetwarzanie historii komunikacji nie powinno wymagać dyplomu z analizy danych. Rozumiejąc ograniczenia ogólnych narzędzi i korzystając z dedykowanej infrastruktury, możesz zamienić lata chaotycznych wiadomości w jasne i zabawne spostrzeżenia.