תארו לעצמכם שאתם מורידים היסטוריית הודעות של חמש שנים עם החברים הכי קרובים שלכם. אתם מחזיקים קובץ של 15MB מלא בבדיחות פנימיות, ויכוחים של אמצע הלילה ואלפי חותמות זמן מקוטעות. אתם מדביקים את החלק הראשון לממשק שיחה גנרטיבי רגיל, בתקווה לקבל סיכום מהנה. במקום זאת, המערכת קורסת, מאבדת מעקב אחרי מי הדובר, או ממציאה שיחות שמעולם לא קרו. כיום, המעבר ממודלי שפה כלליים לארכיטקטורת מדידה ייעודית פותר בדיוק את הבעיה הזו. במקום להסתמך על צ'אטבוט AI סטנדרטי, המשתמשים עוברים לאפליקציות סיכום שנבנו במיוחד (Recap apps) המעבדות ייצואי טקסט מאסיביים בצורה מאובטחת ומפיקות נרטיבים מובנים מבלי לאבד את ההקשר.

העבודה היומיומית שלי כמפתח Back-end כוללת מבנה שירותי תקשורת מבוססי ענן ואינטגרציות API. אני מתמודד עם נתונים גולמיים ולא מובנים ללא הרף. אנשים מניחים שהזנת יומן צ'אט גולמי למודל שפה סטנדרטי היא משימה פשוטה. היא לא. היסטוריית צ'אט היא מבולגנת, לא ליניארית וצפופה. כדי להפיק ערך אמיתי מהיסטוריית ההודעות שלכם, אתם זקוקים לגישה שיטתית לעיבוד נתונים.

שלב 1: למה הרגלי ההודעות שלנו דורשים תשתית טכנית טובה יותר?

לפני שתנסו לנתח את הנתונים שלכם, כדאי להבין את קנה המידה של הבעיה. אנחנו מייצרים יותר נתוני שיחה מאי פעם. על פי נתונים אחרונים מתעשיית המובייל, מספר הסשנים באפליקציות והוצאות הצרכנים ברחבי העולם ממשיכים להגיע לשיאים חדשים, מה שמדגיש את עומק המעורבות הדיגיטלית. ככל שהאינטראקציות הדיגיטליות שלנו מעמיקות, נפח נתוני הטקסט היושב במכשירים שלנו גדל בצורה אקספוננציאלית.

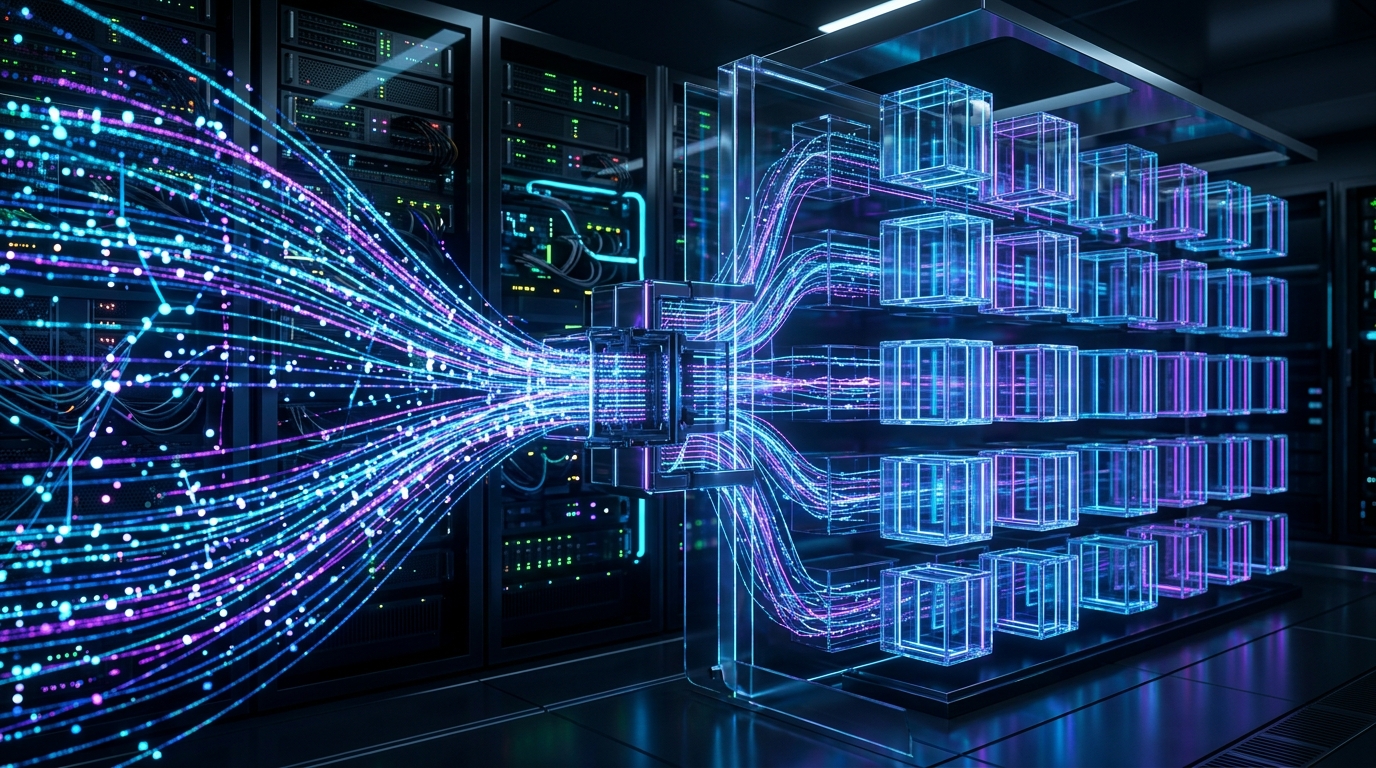

מגמות אחרונות מדגישות שינוי משמעותי לכיוון "AI + ארכיטקטורת מדידה". זהו שינוי יסודי באופן שבו אנחנו מטפלים בנתונים. בינה מלאכותית היא כבר לא רק כלי עצמאי שמתכתבים איתו; היא הופכת לתשתית הבסיסית המשמשת לפילוח נתונים מורכב ועיבוד מקצה לקצה. אם אתם רוצים לנתח את דפוסי התקשורת שלכם, אתם זקוקים לכלים שנבנו על סוג כזה של ארכיטקטורה ייעודית, ולא רק שורת פקודה ריקה.

טיפ לשלב זה: הגדירו את המטרה האמיתית שלכם. הגישה הזו מיועדת ספציפית לאנשים פרטיים, חברים וצוותים קטנים שרוצים להפוך את ייצואי הצ'אט האישיים שלהם לסיכומים מובנים ומשעשעים. היא לא מיועדת לאנליסטים של נתוני CRM ארגוניים המחפשים לבנות צינורות תמיכת לקוחות אוטומטיים.

שלב 2: למה פלטפורמות כלליות נכשלות בשימור הקשר (Context)?

אני בוחן לעיתים קרובות את שאילתות הניתוב שמגיעות למערכות ניתוח ה-Backend. אנשים המחפשים פתרונות מקלידים לעיתים קרובות וריאציות כמו cha t gpt, chat gp t, או אפילו wchat gpt בחנויות האפליקציות. בין אם משתמש מחפש chàt gpt, gbt char, או בוחן ממשקים כמו deepseek ו-grok ai, הבעיה הבסיסית נשארת זהה: מגבלות טוקנים.

כל מערכת צ'אט AI מעבדת טקסט ב"טוקנים". כשאתם מדביקים יומן וואטסאפ גדול לתוך צ'אט GPT רגיל, המודל קורא את חותמות הזמן, השמות והודעות המערכת (כמו "התמונה הושמטה") כטוקנים. הוא מגיע לקיבולת הזיכרון שלו במהירות רבה. עד שהוא מסיים לקרוא את ההודעות של ינואר, הוא כבר שכח מה קרה בנובמבר. הנרטיב קורס.

יתרה מכך, מודלים לשימוש כללי אומנו לענות על שאלות, לא לשמש כאנליסטים של נתונים עבור קבצי JSON או TXT גולמיים. כשהם נתקלים בסלנג או בהחלפת נושאים תכופה — מה שאופייני לצ'אטים קבוצתיים — הם מתחילים להזות (Hallucinate). נדרשת תשתית ייעודית כדי לסנן את הרעש עוד לפני שהמודל מתחיל בניתוח שלו.

שלב 3: איך לזהות את מסגרת הפרטיות והעיבוד הנכונה?

ייצוא נתוני הודעות אישיים דורש שיקולי פרטיות מחמירים. אם אתם מעלים אינטראקציות אישיות של שנה שלמה, עליכם להעריך את מדיניות הטיפול בנתונים של הכלי.

בעת בחירת אפליקציה למשימה זו, השתמשו בקריטריונים הבאים:

- ארעיות הנתונים (Data Ephemerality): האם האפליקציה שומרת את ההודעות שלכם לצמיתות, או שהיא מוחקת את הטקסט הגולמי מיד לאחר סיום הניתוח?

- ספציפיות לפלטפורמה: האם היא יודעת לקרוא באופן טבעי את הפורמט הספציפי שיוצא מאפליקציית המסרים שלכם, ולזהות איפה הודעה אחת מסתיימת ותגובה מתחילה?

- פורמט הפלט: האם היא מספקת קיר טקסט שטוח, או סיכום ויזואלי מושך (כמו סגנון ה-"Wrapped" המוכר)?

כלים כלליים משתמשים לעיתים קרובות בקלט שלכם כדי לאמן מודלים עתידיים. כלי ייעודי צריך לבודד את נתוני הסשן שלכם. המיקוד הגובר בהסכמת נתונים ברור בשוק הרחב; דוחות על שקיפות במעקב אפליקציות (ATT) מראים שמשתמשים הופכים להרבה יותר זהירים לגבי לאן הנתונים שלהם הולכים. בחירת כלי הניתוח שלכם צריכה לשקף את הזהירות הזו.

שלב 4: מה התועלת בפילוח הקשרים עמוק?

מנקודת מבט הנדסית, הפתרון לעיבוד קבצי טקסט מסיביים הוא פילוח הקשרים עמוק (Deep context segmentation). במקום לדחוף קובץ שלם לתוך פרומפט יחיד, מערכת מתוכננת היטב מפרקת את המסמך לבלוקים לוגיים המבוססים על פערים בזמן או שינויי נושא.

בעוד שסיכומי AI כלליים לעיתים קרובות מפשיטים את הניואנסים מהודעות אישיות, אלגוריתמי פילוח ממפים קודם כל את מערכות היחסים בין המשתתפים. הם מזהים מי הדוברים העיקריים, באילו ביטויים משתמשים בתדירות הגבוהה ביותר ומתי מתרחשת פעילות שיא. רק לאחר שהמטא-נתונים הללו מובנים, המערכת מעבירה את הבלוקים המאורגנים ל-Back-end של הבינה המלאכותית ליצירת הנרטיב.

זו הסיבה שחיפוש אחר chats gpt או chatgtp מוביל בדרך כלל לתסכול. לממשק האינטרנט הסטנדרטי פשוט חסרה שכבת העיבוד המקדים הזו. הוא מתייחס להיסטוריה היקרה שלכם כאל מחרוזת תווים אחת ארוכה ומעיקה.

שלב 5: איך לבחור את הכלי הנכון לסיכומי נרטיב?

אם אתם רוצים פירוט מפורט ומשעשע של השיחות שלכם מבלי לבצע הנדסת פרומפטים ידנית, אתם זקוקים לאפליקציה שנבנתה במיוחד עבור זרימת העבודה הזו. Wrapped AI Chat Analysis Recap תוכנן בדיוק למטרה זו. הוא לוקח את קובץ הטקסט המיוצא, מפעיל את פילוח ההקשרים הדרוש, ומייצר סיכום מובנה שמדגיש בדיחות פנימיות, התנהגות משתתפים ומגמות שיחה.

בעבודה צמודה עם צוותי תשתית ב-Dynapps LTD, הבחנתי שמשתמשים מעדיפים פלט ויזואלי דמוי סיפור על פני טבלאות סטטיסטיות גולמיות. אתם לא רק רוצים לדעת ששלחתם 4,000 הודעות; אתם רוצים לדעת מה ההודעות האלה אומרות על הדינמיקה הקבוצתית שלכם. כלי סיכום ייעודי מטפל במורכבות החישובית ומעצב את הפלט לתובנות שניתן לשתף ולעכל בקלות.

שאלות ותשובות מעשיות: מה עוד כדאי לשקול לפני העלאה?

לסיום התהליך, ריכזתי תשובות לשאלות הטכניות הנפוצות ביותר שאני מקבל בנוגע לייצוא צ'אטים:

האם גודל הקובץ משנה?

כן. אם קובץ הטקסט שלכם מעל 20MB, הוא מכיל בדרך כלל שנים של קבצי מדיה (גם אם הם מסומנים רק כטקסט שהושמט) או יומני מערכת כבדים. כלים ייעודיים מחלקים את הנתונים הללו אוטומטית, בעוד שממשק Gemini או ChatGPT סטנדרטי לרוב יסרב להעלאה או יקטע את הקובץ.

למה הסיכום שלי נראה כללי בצ'אטבוטים סטנדרטיים?

כי מודלי AI כלליים מוגדרים כברירת מחדל לטון ניטרלי ואינפורמטיבי. אפליקציה ייעודית מפעילה פרומפטים מוגדרים מראש ובעלי אישיות על הנתונים המפולחים, מה שמוביל לסיכום מרתק ומודע תרבותית שבאמת נשמע כמו אינטראקציה בין חברים אנושיים.

האם החלפת המכשיר שלי תשפיע על הייצוא?

בדרך כלל לא. כל עוד אפליקציית המסרים מייצרת ייצוא TXT או ZIP סטנדרטי של יומני הטקסט שלכם, מנוע ניתוח בנוי כהלכה יקרא את חותמות הזמן ומחרוזות הטקסט בצורה מדויקת, ללא קשר למערכת ההפעלה.

עיבוד היסטוריית התקשורת שלכם לא אמור לדרוש תואר במדעי הנתונים. על ידי הבנת המגבלות של כלים כלליים ושימוש בתשתית ייעודית, תוכלו להפוך שנים של הודעות כאוטיות לתובנות ברורות ומהנות.