Imaginez que vous téléchargiez cinq ans d'historique de messages avec vos amis les plus proches. Vous vous retrouvez avec un fichier de 15 Mo rempli de blagues privées, de débats nocturnes et de milliers de marqueurs temporels fragmentés. Vous copiez-collez le premier bloc dans une interface conversationnelle classique, espérant un résumé amusant. Au lieu de cela, le système plante, perd le fil de qui parle ou invente des conversations qui n'ont jamais eu lieu. Actuellement, la transition des modèles de langage génériques vers une architecture de mesure spécialisée résout précisément ce problème. Plutôt que de s'appuyer sur un chatbot IA standard, les utilisateurs se tournent vers des applications de récapitulation conçues sur mesure qui traitent les exports de texte massifs de manière sécurisée et extraient des récits structurés sans perdre le contexte.

Mon travail quotidien en tant que développeur backend consiste à structurer des services de communication basés sur le cloud et des intégrations d'API. Je traite constamment des données brutes et non structurées. On suppose souvent qu'injecter un journal de chat brut dans un modèle de langage standard est une tâche simple. Ce n'est pas le cas. Les historiques de chat sont désordonnés, non linéaires et denses. Pour tirer une réelle valeur de votre historique de messagerie, vous avez besoin d'une approche méthodique du traitement des données.

Étape 1 : Pourquoi nos habitudes de messagerie exigent-elles une meilleure infrastructure technique ?

Avant de tenter d'analyser vos propres données, il est utile de comprendre l'ampleur du problème. Nous générons plus de données conversationnelles que jamais. Selon les données récentes de l'industrie mobile, les sessions d'applications mondiales et les dépenses des consommateurs continuent d'atteindre des records, soulignant l'intensité de l'engagement mobile. À mesure que nos interactions numériques s'approfondissent, le volume pur de données textuelles stockées sur nos appareils a crû de manière exponentielle.

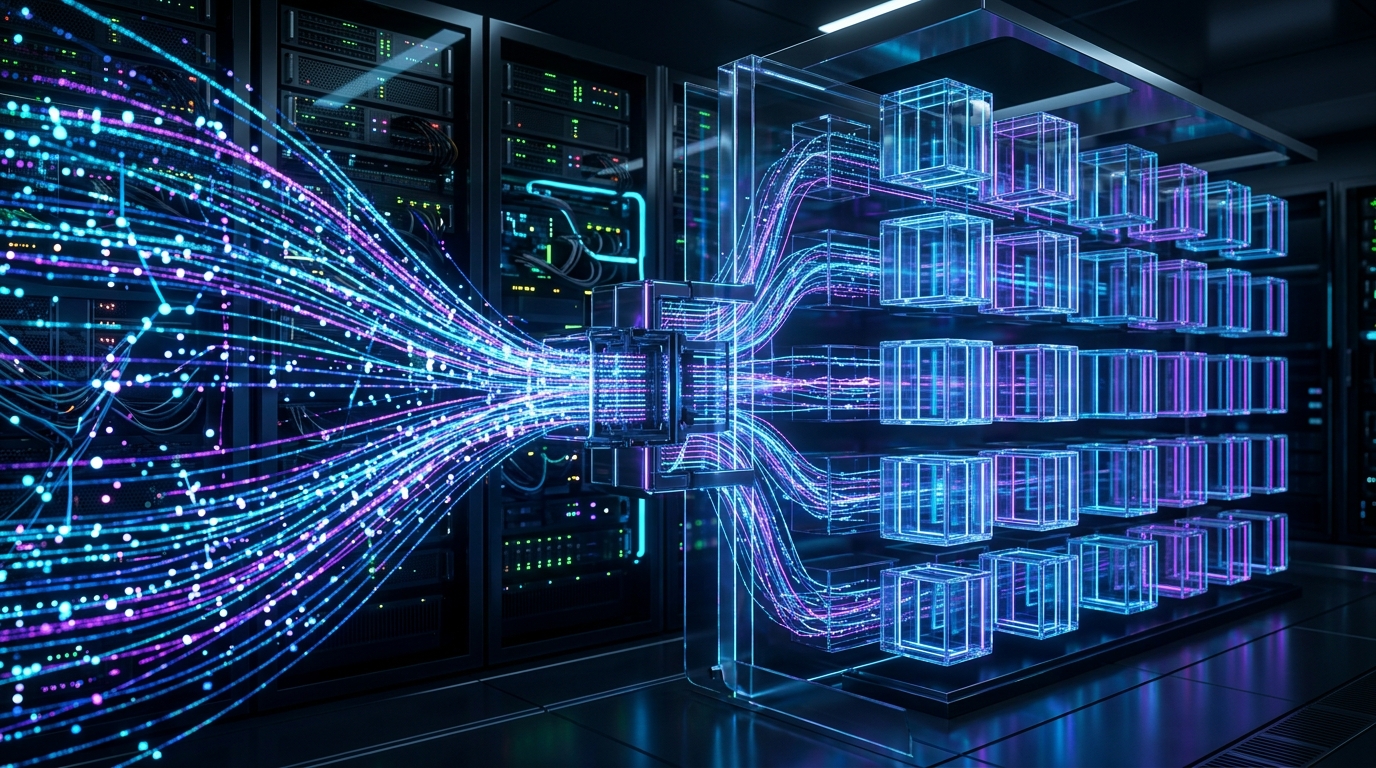

Les tendances récentes mettent en évidence un virage pivot vers l'« IA + Architecture de Mesure ». Cela indique un changement fondamental dans la gestion des données. L'intelligence artificielle n'est plus seulement un outil autonome avec lequel on discute ; elle devient l'infrastructure de base utilisée pour la segmentation de données complexes et le traitement de bout en bout. Si vous souhaitez analyser vos schémas de communication, vous avez besoin d'outils basés sur ce type d'architecture dédiée, et non d'une simple fenêtre de prompt vide.

Conseil pour cette étape : Définissez votre objectif réel. Cette approche s'adresse spécifiquement aux individus, aux amis et aux petites équipes qui souhaitent transformer leurs exports de chat personnels en résumés structurés et divertissants. Elle n'est PAS destinée aux analystes de données CRM d'entreprise cherchant à construire des pipelines de support client automatisés.

Étape 2 : Pourquoi les plateformes généralistes échouent-elles à retenir le contexte ?

J'examine fréquemment les requêtes de routage qui frappent les systèmes d'analyse backend. Les utilisateurs à la recherche de solutions tapent souvent des variantes comme cha t gpt, chat gp t ou même wchat gpt dans les boutiques d'applications. Qu'un utilisateur recherche chàt gpt, gbt char, ou teste des interfaces comme deepseek et grok ai, le problème fondamental reste le même : les limites de jetons (tokens).

Chaque système de chat IA traite le texte en « jetons ». Lorsque vous collez un volumineux journal WhatsApp dans un chat GPT générique, le modèle lit les horodatages, les noms et les messages système (comme « Image omise ») comme des jetons. Il atteint rapidement sa capacité de mémoire. Au moment où il lit les messages de janvier, il a déjà oublié ce qui s'est passé en novembre. Le récit s'effondre.

De plus, les modèles polyvalents sont entraînés pour répondre à des questions, pas pour agir en tant qu'analystes de données pour des fichiers JSON ou TXT bruts. Lorsqu'ils rencontrent de l'argot ou des changements de contexte fréquents — typiques des discussions de groupe — ils hallucinent. Une infrastructure spécialisée est requise pour filtrer le bruit avant même que le modèle ne commence son analyse.

Étape 3 : Comment identifier le bon cadre de confidentialité et de traitement ?

L'exportation de données de messagerie personnelle nécessite des considérations de confidentialité strictes. Si vous téléchargez un an d'interactions personnelles, vous devez évaluer les politiques de gestion des données de l'outil.

Lors de la sélection d'une application pour cette tâche, utilisez ces critères :

- Éphémérité des données : L'application stocke-t-elle vos messages de manière permanente ou supprime-t-elle le texte brut immédiatement après la fin de l'analyse ?

- Spécificité de la plateforme : Peut-elle lire nativement le format spécifique exporté par votre application de messagerie, en reconnaissant où finit un message et où commence une réponse ?

- Format de sortie : Fournit-elle un simple mur de texte ou un résumé visuellement attrayant (comme un format style « Wrapped ») ?

Les outils génériques utilisent souvent vos entrées pour entraîner de futurs modèles. Un outil dédié doit isoler les données de votre session. L'accent croissant mis sur le consentement des données est clair sur le marché global ; les rapports sur l'App Tracking Transparency (ATT) montrent que les utilisateurs deviennent nettement plus prudents quant à la destination de leurs données. Votre choix d'outils d'analyse doit refléter cette prudence.

Étape 4 : Quel est l'avantage de la segmentation contextuelle profonde ?

D'un point de vue technique, la solution pour traiter des fichiers texte massifs est la segmentation contextuelle profonde. Au lieu de forcer un fichier entier dans un seul prompt, un système bien architecturé divise le document en blocs logiques basés sur les écarts temporels ou les changements de sujet.

Alors que les résumés d'IA génériques dépouillent souvent les messages personnels de leurs nuances, les algorithmes de segmentation cartographient d'abord les relations entre les participants. Ils identifient qui sont les principaux interlocuteurs, quelles expressions sont les plus utilisées et quand les pics d'activité surviennent. Ce n'est qu'une fois ces métadonnées structurées que le système transmet les blocs organisés au backend de chat d'intelligence artificielle pour la génération du récit.

C'est pourquoi la recherche de chats gpt ou chatgtp mène généralement à la frustration. L'interface web standard manque simplement de cette couche de prétraitement. Elle traite votre précieux historique comme une seule chaîne de caractères écrasante.

Étape 5 : Comment sélectionner le bon outil pour les résumés narratifs ?

Si vous voulez une analyse détaillée et divertissante de vos conversations sans ingénierie de prompt manuelle, vous avez besoin d'une application construite spécifiquement pour ce flux de travail. Wrapped AI Chat Analysis Recap est conçu exactement dans ce but. Il prend le fichier texte exporté, applique la segmentation contextuelle nécessaire et génère un récapitulatif structuré qui met en lumière les blagues privées, le comportement des participants et les tendances conversationnelles.

En travaillant en étroite collaboration avec les équipes d'infrastructure de Dynapps LTD, j'ai observé que les utilisateurs préfèrent les sorties visuelles sous forme d'histoire aux tableaux statistiques bruts. Vous ne voulez pas seulement savoir que vous avez envoyé 4 000 messages ; vous voulez savoir ce que ces messages disent de la dynamique de votre groupe. Un outil de récapitulation dédié gère la complexité informatique, formatant le résultat en insights partageables et digestes.

Questions Pratiques : Que faut-il considérer d'autre avant de télécharger ?

Pour finaliser ce processus, j'ai compilé les réponses aux questions techniques les plus fréquentes que je reçois concernant les exports de chat :

La taille du fichier est-elle importante ?

Oui. Si votre fichier texte dépasse 20 Mo, il contient généralement des années de pièces jointes multimédias (même si elles sont simplement étiquetées comme texte omis) ou des journaux système lourds. Les outils spécialisés découpent ces données automatiquement, alors qu'une interface Gemini ou ChatGPT standard rejettera souvent le téléchargement ou tronquera le fichier.

Pourquoi mon résumé semble-t-il générique dans les chatbots standard ?

Parce que les modèles d'IA généraux adoptent par défaut un ton neutre et informatif. Une application spécialisée applique des prompts pré-configurés et axés sur la personnalité aux données segmentées, ce qui donne un résumé engageant et culturellement pertinent qui ressemble réellement à des amis humains interagissant.

Le changement d'appareil affectera-t-il l'exportation ?

En règle générale, non. Tant que l'application de messagerie génère un export TXT ou ZIP standard de vos journaux de texte, un moteur d'analyse correctement construit lira les horodatages et les chaînes de texte avec précision, quel que soit le système d'exploitation.

Traiter votre historique de communication ne devrait pas nécessiter un diplôme en science des données. En comprenant les limites des outils généraux et en utilisant une infrastructure sur mesure, vous pouvez transformer des années de messagerie chaotique en insights clairs et divertissants.